„DeepNudes“ – Interview mit ChatGPT über eine neue Form digitalen Missbrauchs

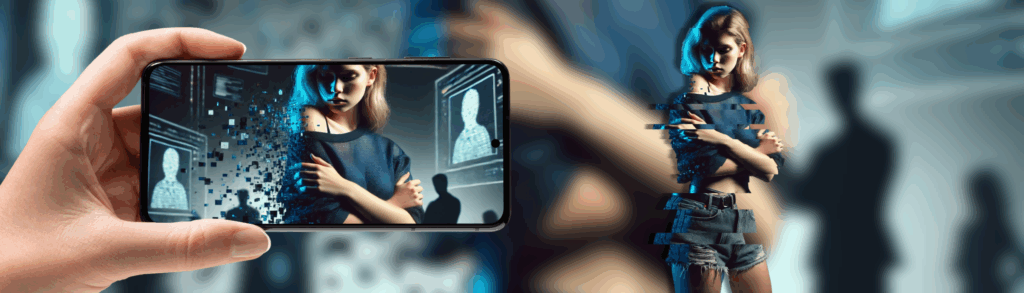

Digitale Nacktbilder, die nie fotografiert wurden – und trotzdem existieren. Willkommen in der Welt von DeepNudes. In diesem Interview spreche ich mit ChatGPT über die Gefahren, technischen Hintergründe und Schutzmöglichkeiten rund um KI-generierte Nacktbilder.

Was sind DeepNudes – und wie funktionieren sie technisch?

Lars (Medienguide):

ChatGPT, kannst du uns erklären, was genau „DeepNudes“ sind?

ChatGPT:

DeepNudes sind KI-generierte Bilder, bei denen eine bekleidete Person so manipuliert wird, dass sie scheinbar nackt erscheint. Das funktioniert über sogenannte generative neuronale Netze, die trainiert wurden, Kleidung digital zu entfernen und durch eine realistisch wirkende Nacktversion zu ersetzen. Das Ergebnis: Bilder, die täuschend echt aussehen – obwohl die Person sich niemals so gezeigt hat.

Warum ist das problematisch – und was macht es zu digitalem Missbrauch?

Lars:

Ich bezeichne DeepNudes klar als digitalen sexuellen Missbrauch. Würdest du das auch so sehen?

ChatGPT:

Absolut. Denn Betroffene haben diesem Bild nie zugestimmt. Es wird ohne ihr Wissen erzeugt – oft mit der Absicht zu demütigen, zu erpressen oder bloßzustellen. Egal ob das Motiv Hass, Lust oder Neugier ist: Es bleibt ein schwerer Eingriff in die Intimsphäre und Identität der Person.

Wie leicht ist es, solche Bilder zu erstellen – und gibt es Schutzmechanismen?

Lars:

Ich habe einige dieser Tools selbst ausprobiert – zu Testzwecken in der Präventionsarbeit. Es war schockierend einfach. Manche Programme fragen immerhin nach Altersnachweisen oder Bildrechten – andere gar nicht. Wie sicher sind KI-Tools aktuell?

ChatGPT:

Die Schutzmaßnahmen sind sehr unterschiedlich. Einige Anbieter setzen Filter ein, andere nicht. Und selbst bei vorhandenen Regeln versuchen Nutzer oft, die Systeme auszutricksen – etwa durch sogenannte Prompt Injection. Das bedeutet: Man umgeht die Sperren durch raffinierte Formulierungen. Deshalb ist technische Kontrolle allein nicht genug – wir brauchen auch rechtliche Regeln und Aufklärung.

Was bedeutet das für neue KI-Technologien wie fotorealistische Bildgeneratoren?

Lars:

Seit April 2025 gibt es neue KI-Systeme, die fotorealistische Bilder erstellen können – auch du gehörst dazu. Ich habe gemerkt, dass bestimmte Inhalte nicht mehr generiert werden dürfen. Was hat sich geändert?

ChatGPT:

OpenAI hat bei den neuen Bildfunktionen klare Grenzen gesetzt. Inhalte, die sexualisiert, gefährlich oder verletzend sind, werden automatisch blockiert. Zudem wird stärker auf die Absicht geachtet: Will jemand etwas Künstlerisches erstellen oder eine Person manipulieren? Diese Bewertung hilft dabei, Missbrauch frühzeitig zu erkennen und zu verhindern.

Warum nutzen Menschen solche Tools überhaupt?

Lars:

Ich glaube, viele denken zuerst an Täter, die andere verletzen wollen. Aber was ist mit Jugendlichen oder Erwachsenen, die einfach verknallt sind oder sexuelle Fantasien haben?

ChatGPT:

Das ist ein wichtiger Punkt. Nicht jeder nutzt solche Tools aus Boshaftigkeit. Manche handeln aus Neugier, unerwiderter Liebe oder Lust – aber auch das ist problematisch. Denn die betroffene Person hat nicht zugestimmt. Es bleibt ein Übergriff, auch wenn die Motivation weniger „kriminell“ wirkt.

Ein Fallbeispiel: Wenn ein DeepNude zur Waffe wird

Lars:

Stellen wir uns eine Schülerin vor – nennen wir sie Lisa. Sie schreibt mit einem Jungen aus ihrer Klasse. Plötzlich taucht ein manipuliertes Nacktfoto von ihr auf – erstellt aus einem Selfie. Was passiert in so einem Fall?

ChatGPT:

Lisa ist Opfer eines digitalen sexuellen Übergriffs. Anfangs könnte die Polizei sogar denken, sie habe das Bild selbst gemacht – was bei Minderjährigen juristisch heikel ist. Sobald klar wird, dass es ein DeepNude ist, liegt eine Straftat vor: Verleumdung, Nötigung, ggf. Cybermobbing. Problematisch ist aber die Beweislage – denn KI-Bilder werden immer realistischer.

Wie können wir uns schützen? Was hilft Betroffenen?

Lars:

Was sind aus deiner Sicht die wichtigsten Schutzmaßnahmen?

ChatGPT:

Hier ein paar klare Empfehlungen:

🔒 1. Vorsicht bei Bildern: Teile keine privaten Fotos leichtfertig – selbst harmlose Selfies können missbraucht werden.

⚙️ 2. Technische Schutzmaßnahmen nutzen: Achte auf Privatsphäre-Einstellungen in Apps und Netzwerken.

📢 3. Verdächtige Inhalte melden: Wenn ein DeepNude auftaucht – sofort Vertrauenspersonen, Schule oder Polizei einschalten.

🧠 4. Aufklärung ist Prävention: Sprich mit Jugendlichen über Risiken und Rechte – bevor es passiert. Und sensibilisiere auch Erwachsene, z. B. in Elternabenden oder Workshops.

Fazit: Zwischen Technik, Verantwortung und Prävention

DeepNudes zeigen, wie verletzlich digitale Identitäten sein können. KI bietet viele Chancen – aber eben auch Missbrauchsrisiken. Deshalb ist es entscheidend, dass wir Wissen teilen, Missbrauch erkennen und gemeinsam für Schutz und digitale Selbstbestimmung einstehen.

🎧 Du willst mehr dazu hören?

👉 Dann hör dir die passende Podcastfolge an:

„DeepNudes – Wie KI den digitalen Missbrauch verändert“ – jetzt überall, wo es Podcasts gibt.